Dự báo AI biến đổi: Bằng chứng ở đâu?

Holden Karnofsky

08/2021

Đây là một trong 4 bài viết tóm tắt từ hàng trăm trang báo cáo kỹ thuật gần như tập trung hoàn toàn vào việc dự báo một con số: năm AI biến đổi phát triển.1

"AI biến đổi", ý tôi là "AI đủ mạnh để đưa chúng ta đến một tương lai mới và khác biệt về chất". Tôi đặc biệt tập trung vào thứ mà tôi gọi là PASTA: Các hệ thống AI về cơ bản có thể tự động hóa tất cả các hoạt động của con người, để tăng tốc độ tiến bộ khoa học và công nghệ cần thiết.

PASTA càng sớm phát triển, thế giới càng có khả năng thay đổi hoàn toàn, và điều đó càng trở nên quan trọng khi chúng ta suy nghĩ ngay từ hôm nay về cách để sự thay đổi đó diễn ra tốt đẹp thay vì tồi tệ.

Trong các phần tiếp theo, tôi sẽ trình bày hai phương pháp để đưa ra "dự đoán tốt nhất" về thời điểm chúng ta có thể mong đợi AI biến đổi phát triển. Nhưng trước tiên, trong phần này, tôi sẽ giải quyết câu hỏi: Các phương pháp dự báo này cần phải tốt như thế nào để chúng ta xem xét một cách nghiêm túc? Hay nói cách khác, "nghĩa vụ chứng minh" để dự báo các mốc thời gian của AI biến đổi là gì?

Khi ai đó dự báo AI biến đổi trong thế kỷ 21, đặc biệt là khi họ hiểu rõ về toàn bộ hậu quả nó sẽ mang lại, thì phản ứng trực giác phổ biến thường là: "Tuyên bố AI biến đổi đang xuất hiện trong thế kỷ này là thực sự bất thường và hoang đường. Vì thế, các tranh luận của bạn nên cần làm tốt hơn".

Tôi nghĩ đây là một phản ứng ban đầu rất hợp lý đối với các dự báo về AI biến đổi (và điều này cũng khớp với phản ứng ban đầu của chính tôi). Nhưng tôi cố gắng kiểm tra xem điều gì thúc đẩy phản ứng và làm thế nào chứng minh được nó, và sau khi làm như vậy, cuối cùng, tôi đã không đồng ý.

- Tôi nghĩ có một số lý do để cho rằng AI biến đổi, hoặc một cái gì đó không kém phần quan trọng, là những thứ có khả năng xảy ra trong thế kỷ này, ngay cả trước khi chúng ta xem xét các chi tiết về nghiên cứu AI, tiến bộ AI, v.v.

- Tôi cũng nghĩ là ở các loại mốc thời gian nhiều thập kỷ mình đang nói đến, nhìn chung, chúng ta nên khá cởi mở với những thay đổi rất lập dị, gây rối, thậm chí mang tính cách mạng. Với bối cảnh này, tôi nghĩ rằng các ước tính cụ thể được nghiên cứu kỹ lưỡng về thời điểm AI biến đổi xuất hiện có thể đáng tin cậy, ngay cả khi chúng liên quan đến rất nhiều phỏng đoán và không chắc chắn.

Bài viết này cố gắng giải thích tôi đến từ đâu.

Dưới đây, tôi sẽ (a) cụ thể hơn một chút về những dự báo về AI biến đổi mà tôi đang bảo vệ; sau đó (b) thảo luận về việc làm thế nào để chính thức hóa phản ứng "Quá hoang đường" đối với các dự báo trên; sau đó (c) đi qua từng hàng bên dưới, mỗi hàng là mỗi cách chính thức hóa khác nhau.

Để minh bạch, lưu ý rằng các báo cáo ở ba hàng sau đều là các phân tích của Open Philanthropy. Và tôi là đồng Giám đốc điều hành của Open Philanthropy.

Một số xác suất thô

Dưới đây là một số điều tôi tin về AI biến đổi và cố gắng bảo vệ:

- Tôi nghĩ rằng có hơn 10% cơ hội cho chúng ta thấy một cái gì đó giống với PASTA đủ để đủ điều kiện là "AI biến đổi" trong vòng 15 năm (vào năm 2036); ~50% cơ hội cho chúng ta thấy nó trong vòng 40 năm (vào năm 2060); và ~2/3 cơ hội cho chúng ta thấy nó trong thế kỷ này (vào năm 2100).

- Với điều kiện trên, tôi nghĩ rằng có ít nhất 50% khả năng chúng ta sẽ sớm thấy một thế giới điều hành bởi người kỹ thuật số hoặc AI lệch căn chỉnh hoặc một cái gì đó khác hợp lý có thể khiến chúng ta "chuyển sang trạng thái như đã biết là con người không còn là lực lượng chính trong các sự kiện thế giới." (Điều này tương ứng với điểm số #1 trong định nghĩa "thế kỷ quan trọng nhất" của tôi ở lộ trình).

- Với điều kiện trên, tôi nghĩ rằng có ít nhất 50% khả năng lực lượng chính trong các sự kiện thế giới có thể tạo ra một nền văn minh toàn thiên hà ổn định trong hàng tỷ năm tới. (Điều này tương ứng với điểm số #2 trong định nghĩa "thế kỷ quan trọng nhất" của tôi ở lộ trình.)

Tôi cũng đã trình bày chi tiết hơn một chút về ý nghĩa của "thế kỷ quan trọng nhất" ở đây.

Chính thức hóa phản ứng "Quá hoang đường"

Thông thường, với ai đó đưa ra một quan điểm mà tôi không thể ngay lập tức tìm thấy lỗ hổng cụ thể, theo bản năng, tôi lại nghĩ nó "quá hoang đường" nếu xảy ra. Ví dụ: "Công ty khởi nghiệp của tôi sẽ trở thành Google tiếp theo" hoặc "Trường Cao đẳng sẽ lỗi thời sau 10 năm nữa" hoặc "Là Tổng thống, tôi sẽ đưa cả hai đảng đi cùng với nhau thay vì chỉ là đảng phái”.

Tôi đưa ra giả thuyết rằng "Phản ứng này quá hoang đường" đối với những tuyên bố như thế này thường được chính thức hóa theo các dòng sau: "Bất kể lập luận của bạn cho X là có thể, thì có một số cách nhìn nổi bật về mọi thứ (thường được đơn giản hóa quá mức, nhưng có liên quan) khiến X trông rất khó xảy ra."

Đối với các ví dụ tôi vừa đưa ra:

- "Công ty khởi nghiệp của tôi sẽ trở thành Google tiếp theo”. Ta có một lượng lớn các công ty khởi nghiệp (hàng triệu?), và phần lớn trong số họ không hoàn thành bất cứ thứ gì giống như Google. (Ngay cả khi những người sáng lập của họ nghĩ rằng họ sẽ làm!)

- "Trường cao đẳng sẽ lỗi thời trong 10 năm tới”. Trường cao đẳng đã rất không lỗi thời trong hàng trăm năm.

- "Với tư cách là Tổng thống, tôi sẽ đưa cả hai đảng đi cùng với nhau thay vì chỉ là đảng phái". Đây là một điều phổ biến đối với các tổng thống tương lai của Hoa Kỳ, nhưng tình trạng đảng phái dường như đã trở nên tồi tệ hơn trong ít nhất một vài thập kỷ.

Mỗi trường hợp này thiết lập một loại điểm khởi đầu (hoặc xác suất "tiên nghiệm) và "nghĩa vụ chứng minh", sau đó chúng ta có thể xem xét thêm các bằng chứng khắc phục được gánh nặng đó. Đó là khi chúng ta có thể hỏi những điều như: điều gì làm cho công ty khởi nghiệp này khác với nhiều công ty khởi nghiệp khác cho rằng các công ty này có thể trở thành Google tiếp theo? Điều gì làm cho thập kỷ sắp tới khác biệt với tất cả các thập kỷ trước khi cao đẳng giữ vai trò quan trọng? Ứng cử viên Tổng thống này có gì khác so với vài ứng cử viên gần đây?

Có một số cách khác để nghĩ về nghĩa vụ chứng minh cho các tuyên bố của tôi ở trên: một số cách để lấy xác suất tiên nghiệm ("điểm bắt đầu"), sau đó cập nhật xác suất này bằng các bằng chứng khác.

Nhiều người trong số này nắm bắt các khía cạnh khác nhau của trực giác "việc đó quá hoang đường", họ tạo ra các xác suất tiên nghiệm (ít nhất là lúc ban đầu) làm cho các xác suất tôi đã đưa ra trông có vẻ quá cao.

Dưới đây, tôi sẽ đi qua một số "xác suất tiên nghiệm" này và xem xét ý nghĩa của chúng đối với "nghĩa vụ chứng minh" lên các phương pháp dự báo mà tôi sẽ thảo luận trong các bài viết sau.

Các góc độ khác nhau về nghĩa vụ chứng minh

Chủ nghĩa hoài nghi "Thế kỷ quan trọng nhất"

Ta có thể hiểu một khía cạnh về nghĩa vụ chứng minh qua các dòng sau:

- Holden tuyên bố xác suất 15-30% rằng đây là "thế kỷ quan trọng nhất" theo nghĩa này hay nghĩa khác.3

- Nhưng có rất nhiều thế kỷ, và theo định nghĩa, hầu hết trong các số đó không thể là quan trọng nhất. Cụ thể:

- Con người đã tồn tại từ khoảng 50.000 đến ~5 triệu năm, tùy thuộc vào cách bạn định nghĩa "con người".4 Thời gian đó là từ 500 đến 50.000 thế kỷ.

- Nếu chúng ta giả định rằng tương lai dài như quá khứ của chúng ta, thì có tổng cộng 1.000 đến 100.000 thế kỷ.

- Vậy nên xác suất tiên nghiệm (điểm bắt đầu) cho “thế kỷ quan trọng nhất” là từ 1/100,000 đến 1/1,000.

- Điều thực sự tồi tệ hơn là khi Holden nói về nền văn minh kéo dài đến hàng tỷ năm. Đó là hàng chục triệu thế kỷ, vì vậy xác suất tiên nghiệm của "thế kỷ quan trọng nhất" là ít hơn 1/10.000.000.

(Bài viết Chúng ta có đang sống ở bản lề của lịch sử không? lập luận theo những dòng chung này, mặc dù có chút khác biệt.5)

Tôi cảm thấy lập luận này khá gần với việc nắm bắt nguồn gốc lớn nhất trong do dự ngày trước của mình về giả thuyết "thế kỷ quan trọng nhất". Tuy nhiên, tôi nghĩ có rất nhiều dấu hiệu cho thấy đây không phải là một thế kỷ trung bình, ngay cả trước khi chúng ta xem xét các lập luận cụ thể về AI.

Trong bài viết trước của tôi nhấn mạnh một điểm quan trọng, "Tất cả các quan điểm khả thi về tương lai nhân loại đều là hoang đường". Nếu bạn nghĩ rằng con người (hoặc con cháu của chúng ta) còn hàng tỷ năm phía trước, bạn nên thấy chúng ta là một trong những loài người đầu tiên, điều này làm cho thời đại của ta trở nên hợp lý hơn nhiều khi nằm trong số những thời đại quan trọng nhất. (Điều này cũng được nhấn mạnh trong bài Suy ngẫm về thực hư chuyện chúng ta đang sống ở thời điểm có ảnh hưởng nhất trong lịch sử, cũng như các bình luận trong phiên bản trước đó của bài "Chúng ta có đang sống ở bản lề của lịch sử không?".)

Ngoài ra, trong khi nhân loại đã tồn tại được vài triệu năm, thì phần lớn thời gian đó dân số chúng ta cực kỳ thấp và có rất ít cách kết hợp tiến bộ công nghệ. Nền văn minh nhân loại bắt đầu khoảng 10.000 năm trước, và kể từ đó, chúng ta đã đạt được đến mức xây dựng nên máy tính có khả năng lập trình kỹ thuật số và khám phá Hệ Mặt Trời.

Những luận điểm này trông có vẻ hợp lý khi nghĩ rằng chúng ta cuối cùng sẽ khởi động một nền văn minh toàn thiên hà ổn định, đôi khi trong 100.000 năm tới (1000 thế kỷ). Hoặc nghĩ rằng chúng ta chỉ có 10% khả năng làm vậy vào thời điểm nào đó trong 10.000 năm tới (100 thế kỷ). Dù bằng cách nào thì đều cho biết rằng một thế kỷ nhất định có ~1/1,000 cơ hội trở thành thế kỷ quan trọng nhất để nền văn minh đó ra đời, cao hơn nhiều so với các số liệu đưa ra trước đó trong phần này. Nó vẫn khác ~100 lần so với những con số tôi đưa ra ở trên, vì vậy vẫn còn là một nghĩa vụ chứng minh.

Ta có thêm lý do để nghĩ rằng thế kỷ đặc biệt này không bình thường. Ví dụ: xem bài Không thể tiếp tục được nữa.

- Tổng quy mô nền kinh tế thế giới tăng trưởng nhiều hơn trong 2 thế kỷ qua so với toàn bộ phần còn lại của lịch sử cộng lại.

- Tốc độ tăng trưởng kinh tế hiện tại không thể duy trì trong hơn 80 thế kỷ nữa hay trong tầm đó. (Và như đã thảo luận dưới đây, nếu tốc độ tăng trưởng trong quá khứ tiếp tục có xu hướng tăng tốc, thì sẽ dẫn đến tăng trưởng bùng nổ và đạt tới giới hạn của những gì có thể xảy ra trong thế kỷ này.)

- Điều hợp lý là khoa học đã tiến bộ hơn trong 5 thế kỷ qua so với phần còn lại của lịch sử cộng lại.

Một điều cuối cùng làm cho quãng thời gian của chúng ta trở nên đặc biệt: chúng ta đang nói về thời điểm xuất hiện AI biến đổi, và chúng ta đang sống rất gần với thời gian khởi đầu những nỗ lực về AI.

Trong chưa đầy 1 thế kỷ, chúng ta đã đi từ chiếc máy tính điện tử đa năng có khả năng lập trình đầu tiên cho đến các mô hình AI có thể cạnh tranh với con người về nhận dạng giọng nói, 6 phân loại hình ảnh và nhiều hơn nữa.

Tìm hiểu thêm về ý nghĩa của điều này trong phần tiếp theo.

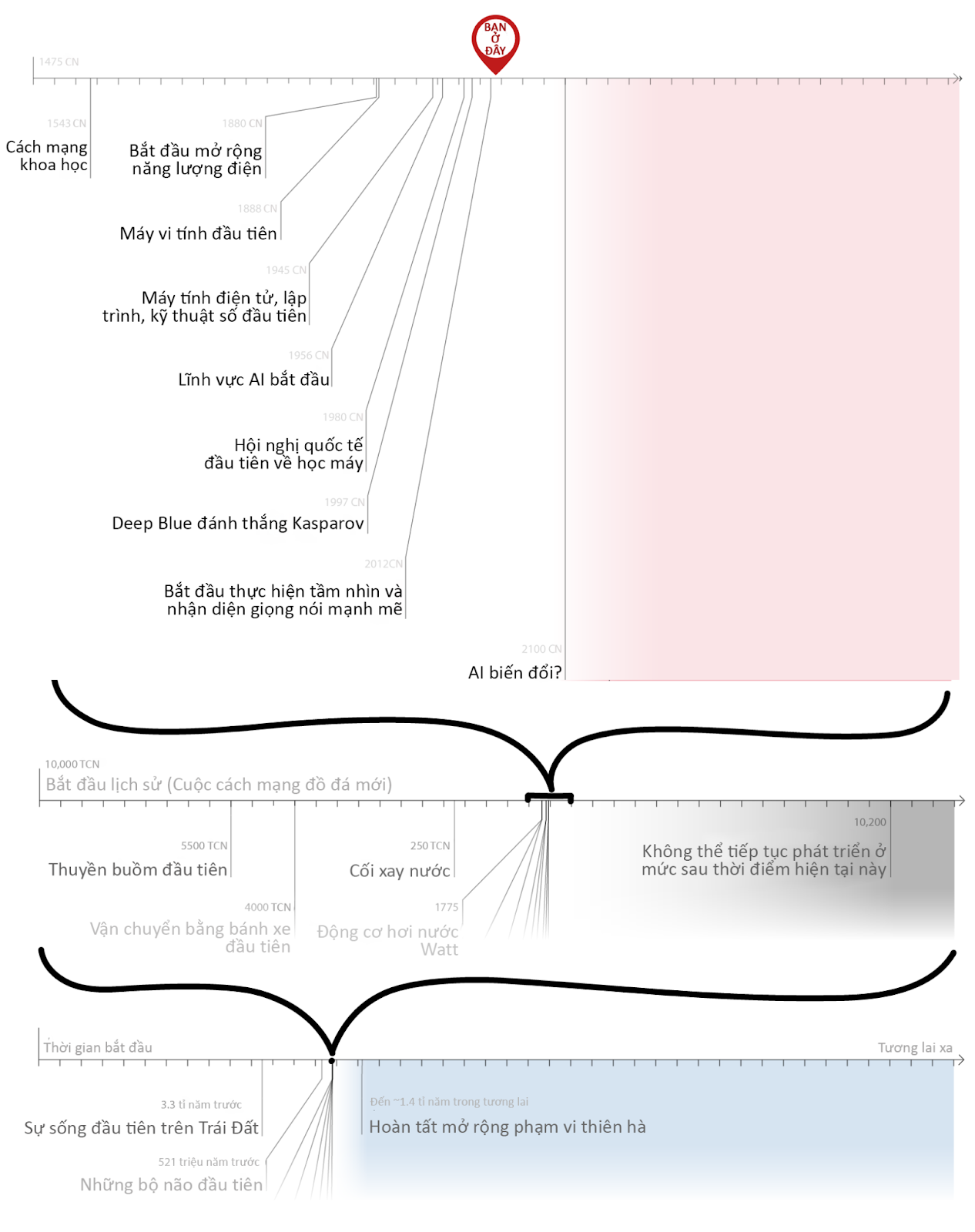

Cảm ơn María Gutiérrez Rojas vì đồ thị này. Dòng thời gian phía trên minh họa mức độ gần đây của các cột mốc quan trọng chính trong lĩnh vực máy tính và AI. Phía dưới đó là các dòng thời gian khác (đã được cắt) cho thấy giai đoạn vài trăm năm này (xem thêm tại bài viết Không thể tiếp tục được nữa), và kỷ nguyên này (xem thêm tại bài viết Tất cả các quan điểm khả thi về tương lai nhân loại đều hoang đường), dường như quan trọng đến mức nào.

Các tiên nghiệm bán thông tin

Báo cáo về các tiên nghiệm bán thông tin (được viết tắt trong phần này là "Tiên nghiệm bán thông tin") là một nỗ lực mở rộng để dự báo các mốc thời gian AI biến đổi trong khi sử dụng càng ít thông tin về các chi tiết cụ thể của AI càng tốt. Vì vậy, đó là một cách cung cấp góc nhìn về "nghĩa vụ chứng minh" - nghĩa là thiết lập một bộ xác suất trước (điểm khởi đầu) khi AI biến đổi phát triển, trước khi chúng ta xem xét bằng chứng chi tiết.

Thông tin trung tâm cần sử dụng là về lượng nỗ lực đã bỏ ra để phát triển AI cho đến nay. Với ý tưởng cơ bản như sau:

- Nếu chúng ta đã cố gắng và thất bại khi phát triển AI biến đổi trong hàng ngàn năm, thì tỷ lệ thành công trong các thập kỷ tới sẽ thấp.

- Nhưng nếu chúng ta chỉ cố gắng phát triển các hệ thống AI trong một vài thập kỷ cho đến nay, thì những thập kỷ tới có thể chứa phần lớn tất cả các nỗ lực từng được đưa vào trước đó. Tỷ lệ để phát triển nó trong thời gian đó không phải là quá thấp.

- Một cách suy nghĩ về điều này là trước khi nhìn vào chi tiết của tiến bộ AI, chúng ta nên phần nào hoài nghi khi cho rằng phát triển AI biến đổi tương đối "dễ dàng" (có thể thực hiện trong vài thập kỷ) hay "khó khăn" (mất hàng ngàn năm). Vì mọi thứ vẫn còn sớm, khả năng "dễ dàng" vẫn còn mở.

Tìm hiểu thêm một chút về cách tiếp cận và kết luận của báo cáo:

Khía cạnh phân tích. Báo cáo đặt ra câu hỏi sau (diễn giải): "Giả sử bạn bị cô lập vào ngày mọi người bắt đầu đầu tư xây dựng hệ thống AI. Và giả sử bây giờ bạn nhận được thông tin cập nhật hàng năm về (a) bao nhiêu năm mọi người đã cố gắng xây dựng AI biến đổi; (b) họ đã 'đầu tư' bao nhiêu vào nó (về thời gian và tiền bạc); (c) liệu họ đã thành công chưa (cho đến nay, họ chưa). Vậy bạn có thể dự đoán gì về các mốc thời gian AI biến đổi chỉ với những thông tin đó, tính đến năm 2021?"

Các phương pháp của bài báo cáo lấy cảm hứng từ Bài toán Mặt trời mọc: "Giả sử bạn không biết gì về vũ trụ, ngoại trừ việc mỗi ngày Mặt Trời có mọc hay không. Cứ cho là đến nay đã có N ngày, và mặt trời đều mọc vào các ngày này, thì xác suất mặt trời sẽ mọc vào ngày mai là bao nhiêu?". Bạn không cần phải biết bất cứ điều gì về thiên văn học để có được câu trả lời thỏa đáng, có những phương pháp toán học đơn giản để ước tính xác suất X sẽ xảy ra vào ngày mai, dựa trên thực tế là X đã xảy ra mỗi ngày trong quá khứ. "Tiên nghiệm bán thông tin" mở rộng các phương pháp toán học này để thích ứng với các mốc thời gian AI biến đổi. (Trong trường hợp này, "X" là "Phát triển AI biến đổi thất bại, như chúng ta đã làm trong quá khứ”).

Kết luận. Tôi sẽ không đi sâu chi tiết về bài phân tích hoạt động như thế nào (xem bài báo cáo tóm tắt đăng trên blog để biết thêm chi tiết), nhưng kết luận của báo cáo bao gồm những điều sau:

- Xác suất của Trí tuệ nhân tạo tổng quát (AGI, bao gồm PASTA) vào năm 2036 là từ 1-18%, với dự đoán tốt nhất là 8%.

- Báo cáo đưa ra xác suất AGI vào năm 2060 là khoảng 3-25% (dự đoán tốt nhất ~13%) và xác suất AGI vào năm 2100 vào khoảng 5-35%, dự đoán tốt nhất là 20%.

Đây là những xác suất thấp hơn tôi đưa ra ở trên, nhưng không thấp hơn nhiều. Điều này cho biết dù đưa ra các chi tiết bổ sung cụ thể về đầu tư và tiến bộ AI cũng không đủ bằng chứng.

Ghi chú về ngày bắt đầu chế độ. Một điều thú vị ở đây là báo cáo ít nhạy cảm hơn việc người ta nghĩ về cách chúng tôi xác định "ngày bắt đầu" để cố gắng phát triển AGI. (Xem mục này ở bản báo cáo đầy đủ). Đó là:

- Theo mặc định, "Tiên nghiệm bán thông tin" mô hình hóa tình hình như thể nhân loại bắt đầu "cố gắng" xây dựng AGI vào năm 1956.7 Có nghĩa là chúng ta mới nỗ lực khoảng 65 năm tuổi, vì vậy, phần lớn nỗ lực sẽ đại diện ở những thập kỷ tới.

- Nhưng bài báo cáo cũng xem xét các biện pháp khác về "nỗ lực xây dựng AGI" - đặc biệt là thời gian nghiên cứu và "tính toán" (sức mạnh xử lý). Ngay cả khi bạn muốn nói rằng chúng ta đã ngầm cố gắng xây dựng AGI kể từ khi bắt đầu văn minh nhân loại khoảng 10.000 năm trước, thì phần lớn nỗ lực nghiên cứu và tính toán cũng sẽ được đầu tư để làm được như vậy trong các thập kỷ tới.

Điểm mấu chốt trong phần này.

- Thỉnh thoảng tôi sẽ nghe ai nói điều gì đó như kiểu "Chúng tôi đã cố gắng xây dựng AI biến đổi trong nhiều thập kỷ và vẫn chưa làm được, thì tại sao bạn nghĩ tương lai sẽ khác?". Báo cáo này ít nhất củng cố những gì tôi thấy, qua quan điểm thông thường rằng một vài thập kỷ "chưa có AI biến đổi, bất chấp ta nỗ lực xây dựng nó" không làm được gì nhiều để tranh luận về khả năng AI biến đổi đến trong thập kỷ tới hoặc ít hơn.

- Trên thực tế, trong toàn cảnh, chúng ta sống cực kỳ gần với giai đoạn đầu nỗ lực phát triển AI - một cách khác làm cho thế kỷ của chúng ta "đặc biệt", đến nỗi chúng ta không nên quá ngạc nhiên nếu hóa ra nó là chìa khóa để phát triển AI.

Tăng trưởng kinh tế

Một góc độ khác về nghĩa vụ chứng minh tương tự:

Nếu PASTA được phát triển sớm bất cứ lúc nào, và nếu nó có những hậu quả kể đến trong loạt bài đăng này, thì đây sẽ là sự thay đổi lớn trên thế giới, trong khi thế giới đơn giản là không thay đổi nhanh như vậy.

Để định lượng điều này, ta có nền kinh tế thế giới tăng trưởng ở mức vài phần trăm mỗi năm trong hơn 200 năm qua và PASTA sẽ cho biết tốc độ tăng trưởng nhanh hơn nhiều, có thể là 100% mỗi năm trở lên.

Nếu chúng ta hướng tới một thế giới tăng trưởng kinh tế bùng nổ, nên đẩy nhanh tăng trưởng kinh tế ngay từ ngày hôm nay. Nó không tăng trưởng, mà đang trì trệ, ít nhất là ở các nền kinh tế phát triển nhất. Nếu AI thực sự sẽ cách mạng hóa mọi thứ, điều tối thiểu bây giờ nó có thể làm là tạo ra đủ giá trị: đủ sản phẩm, giao dịch và các công ty mới - để tăng tốc độ tăng trưởng kinh tế nói chung của Hoa Kỳ.

AI có thể dẫn đến các công nghệ mới tuyệt vời, nhưng nó không có dấu hiệu gì đến tầm quan trọng như PASTA có thể. Đi từ nơi chúng ta đang ở đến nơi PASTA đưa chúng ta đến là một thứ thay đổi đột ngột chưa từng xảy ra trong quá khứ, và không có khả năng xảy ra trong tương lai.

(Nếu bạn không quen với tăng trưởng kinh tế, bạn có thể đọc phần giải thích ngắn gọn của tôi trước khi tiếp tục).

Tôi nghĩ đây là một quan điểm hợp lý, và nó đặc biệt khiến tôi hoài nghi về những dự báo thực sự sẽ xảy ra về AI biến đổi (năm 2036 và sớm hơn).

Câu trả lời chính của tôi là bức tranh về tăng trưởng ổn định - "nền kinh tế thế giới tăng trưởng ở mức vài phần trăm mỗi năm" sẽ trở nên phức tạp hơn rất nhiều khi chúng ta nhìn lại toàn bộ lịch sử kinh tế, trái ngược với trong chỉ vài thế kỷ qua. Từ quan điểm đó, tăng trưởng kinh tế chủ yếu sẽ tăng tốc 8 , và dự phóng sự tăng tốc này thể dẫn đến tăng trưởng kinh tế rất nhanh trong các thập kỷ tới.

Tôi đã viết về điều này trước đây trong bài Máy sao chép và Không thể tiếp tục được nữa; dưới đây tôi sẽ tóm tắt ngắn gọn các báo cáo chính tôi đã trích dẫn trong đó.

AI tiên tiến có thể thúc đẩy tăng trưởng kinh tế bùng nổ không? Đặt câu hỏi rõ ràng: "Định nghĩa "Khả năng 'tăng trưởng bùng nổ', tức >30% tăng trưởng hàng năm của nền kinh tế thế giới - vào năm 2100 là như thế nào?". Ta xem xét lập luận của cả hai bên, bao gồm cả (a) quan điểm lâu dài về lịch sử cho thấy sự tăng trưởng nhanh chóng; và (b) thực tế tăng trưởng đã ổn định đáng kể trong khoảng 200 năm qua, ngụ ý rằng có thể có thứ gì đó thay đổi.

Báo cáo kết luận: "Khả năng tăng trưởng dài hạn là rất lớn. Cả tăng trưởng bùng nổ và trì trệ đều hợp lý".

Trong Mô hình hóa Quỹ đạo Con người hỏi rằng chúng ta có thể mong đợi điều gì trong tương lai nếu như cứ ngoại suy các xu hướng hiện có trong quá trình lịch sử kinh tế. Câu trả lời là tăng trưởng bùng nổ vào năm 2043-2065, không quá xa so với những khả năng tôi đề xuất ở trên. Qua đó, việc thiếu tăng tốc kinh tế trong tầm 200 năm qua có thể là một "điểm sáng" - sẽ sớm được giải quyết bởi sự phát triển công nghệ giúp khôi phục vòng lặp phản hồi (thảo luận trong bài Máy sao chép) có thể khiến tiếp tục tăng tốc.

Để rõ ràng, cũng có những lý do chính đáng để ta không đặt quá nhiều trọng tâm vào điều này như một phép chiếu 9 và tôi trình bày nó như một quan điểm về "nghĩa vụ chứng minh" hơn là dự báo chính xác cho việc khi nào PASTA phát triển.

Lịch sử "thổi phồng AI"

Một góc nhìn khác về nghĩa vụ chứng minh: Tôi đôi khi nghe những bình luận đại loại như "AI đã bị thổi phồng quá mức nhiều lần trong quá khứ, và AI biến đổi 10 luôn 'sắp đến' theo lời của các nhà công nghệ đầy phấn khích. Ước tính của bạn chỉ là ước tính mới nhất trong cách truyền thống này. Vì các ước tính trước đây đã sai, có lẽ bạn cũng vậy".

Tuy nhiên, tôi không nghĩ rằng lịch sử của "thổi phồng AI" lại đưa ra kiểu tuyên bố này. Chúng ta nên học điều gì từ các dự báo AI trong quá khứ? đã xem xét lịch sử của AI để cố gắng hiểu mô hình lịch sử thực tế của "sự thổi phồng AI" là gì.

Tóm tắt của bài viết đưa ra những ấn tượng sau (lưu ý rằng "HLMI", hoặc "trí thông minh máy móc ở cấp độ con người" là một ý tưởng khá giống với PASTA):

- Đỉnh cao của cường điệu AI gần như là từ năm 1956-1973. Tuy nhiên, sự cường điệu của một số dự đoán AI nổi tiếng nhất trong giai đoạn này thường bị phóng đại.

- Tầm sau năm 1973, gần như rất ít chuyên gia thảo luận về HLMI (hoặc cái gì đó tương tự) như là một khả năng trong trung hạn, một phần vì nhiều chuyên gia đã học được từ thất bại trong việc lạc quan quá mức với lĩnh vực này trước đó.

- Giai đoạn lớn thứ hai của cường điệu AI là vào đầu những năm 1980, dường như tập trung nhiều hơn vào khả năng của các "hệ thống chuyên gia" có mục đích hẹp, hữu ích về mặt thương mại, chứ không phải về HLMI (hoặc cái gì đó tương tự)...

- Tôi không rõ liệu tôi có bị thuyết phục bởi những lời phê bình đương thời về sự lạc quan ban đầu về AI hay không, hay liệu tôi có nghĩ đến việc đặt ra những câu hỏi hoài nghi đúng đắn vào thời điểm đó hay không. Phê bình thực chất nhất trong những năm đầu là phê bình của Hubert Dreyfus, tôi đoán là tôi sẽ thấy nó thuyết phục vào thời điểm đó, nhưng tôi không thể tự tin về điều này.

Tóm tắt của tôi không hoàn toàn công bằng khi nói rằng có nhiều làn sóng dự báo riêng biệt và quá mức táo bạo về AI biến đổi. Có lẽ, trong giai đoạn 1956-1973 đã có những kỳ vọng quá cao, nhưng tôi không nghĩ là có nhiều lý do ở đây để áp đặt một "nghĩa vụ chứng minh" khổng lồ cho các ước tính nghiên cứu kỹ lưỡng ngày nay.

Các góc độ khác về nghĩa vụ chứng minh

Dưới đây là một số cách khả thi khác ghi lại phản ứng "Thật là quá hoang đường":

Tuyên bố "Lý do của tôi rất quan trọng". Trên khắp thế giới ngày nay và trong suốt lịch sử, có nhiều người tuyên bố hoặc đã từng tuyên bố rằng bất kỳ vấn đề nào họ đang giải quyết đều cực kỳ quan trọng, thường là nó có thể có tầm ảnh hưởng toàn cầu hoặc thậm chí trên toàn thiên hà. Hầu hết trong số họ phải sai.

Ở đây tôi nghĩ câu hỏi quan trọng là liệu tuyên bố này có được hỗ trợ bởi các lập luận tốt hơn và/hoặc những người đáng tin cậy hơn; so với các tuyên bố "Lý do của tôi rất quan trọng" khác hay không. Nếu bạn đang đọc sâu về giả thuyết "thế kỷ quan trọng nhất", tôi nghĩ bạn đang đặt mình vào một vị trí tốt để trả lời câu hỏi này cho chính mình.

Ý kiến chuyên gia sẽ được đề cập rộng rãi ở các bài đăng trong tương lai. Hiện tại, quan điểm chính của tôi là những tuyên bố tôi đưa ra không mâu thuẫn với đồng thuận của một chuyên gia cụ thể, cũng không được hỗ trợ bởi một chuyên gia nào. Thay vào đó, chúng là những tuyên bố về các chủ đề mà đơn giản là không có “lĩnh vực” chuyên gia nào chuyên tâm nghiên cứu. Một số người có thể chọn bỏ qua bất kỳ tuyên bố nào không được tích cực ủng hộ bởi sự đồng thuận vững chắc của giới chuyên môn; nhưng xét đến mức độ nghiêm trọng của vấn đề, tôi không nghĩ đó là điều chúng ta nên làm trong trường hợp này.

(Điều đó nói rằng, kết luận của cuộc khảo sát tốt nhất hiện có bởi các nhà nghiên cứu AI có vẻ phù hợp với kết luận của tôi, như tôi sẽ thảo luận trong bài viết tiếp theo).

Phản ứng "Quá hoang đường" chưa được nắm bắt. Tôi chắc rằng bài viết này đã không nắm bắt được mọi góc độ có thể để là cơ sở của phản ứng "Đó là quá hoang đường". (Mặc dù không phải vì thiếu cố gắng!) Một số người sẽ chỉ đơn giản với trực giác không thể chối cãi là các tuyên bố trong loạt bài này quá hoang đường để thực hiện nghiêm túc.

Một cái nhìn tổng quát về các góc độ này. Điều khiến tôi khó chịu trong hầu hết các khía cạnh ở phần này là chúng có vẻ quá chung chung. Nếu bạn chỉ đơn giản từ chối (không có bằng chứng áp đảo) để tin bất kỳ tuyên bố nào phù hợp với mô hình "nguyên nhân của tôi là rất quan trọng", hoặc chưa được ủng hộ bởi sự đồng thuận vững chắc của giới chuyên môn, hoặc đơn giản là nghe có vẻ hoang đường, điều đó có vẻ như là một mô hình lý luận nguy hiểm. Có lẽ một số người, đôi khi sẽ sống trong thế kỷ quan trọng nhất; chúng ta nên nghi ngờ về bất kỳ mô hình lý luận nào đáng tin cậy 11 khiến những người này kết luận rằng họ không phải như vậy.

*) Chú thích:

- Tất nhiên, câu trả lời có thể là "Một thời gian vô cùng dài trong tương lai" hoặc "Không bao giờ”.

- Về mặt kỹ thuật, những xác suất này dành cho “trí tuệ nhân tạo tổng quát”, chứ không phải AI biến đổi. Xác suất cho AI biến đổi có thể cao hơn nếu như có AI biến đổi mà không cần trí tuệ nhân tạo tổng quát, ví dụ như thông qua một thứ gì đó như PASTA.

- Điều này tương ứng với hai gạch đầu dòng thứ hai của phần này.

- Từ Wikipedia: "Các phép đo di truyền chỉ ra rằng dòng vượn người làm cho Homo sapiens tách ra khỏi dòng dõi dẫn đến tinh tinh và bonobo, họ hàng còn sống gần nhất của người hiện đại, khoảng 4,6 đến 6,2 triệu năm trước.[23] Con người hiện đại về mặt giải phẫu đã xuất hiện ở châu Phi khoảng 300.000 năm trước,[24] và đạt đến sự hiện đại về hành vi khoảng 50.000 năm trước.[25]

- Ví dụ: Điều đó nhấn mạnh tỷ lệ trong số những "người" quan trọng nhất thay vì "thế kỷ."

- Tôi không có nguồn tốt duy nhất về việc này, mặc dù bạn có thể xem bài viết này.Ấn tượng không chính thức của tôi khi nói chuyện với những người trong lĩnh vực này là nhận dạng giọng nói AI ít nhất khá giống với con người, nếu không muốn nói là tốt hơn.

- "Lĩnh vực AI phần lớn được cho là bắt đầu ở Dartmouth vào năm 1956".

- Có cuộc tranh luận mở rằng liệu dữ liệu kinh tế trong quá khứ có thực sự cho thấy tăng tốc bền vững hay không, trái ngược với chuỗi các khoảng thời gian rất khác nhau có tốc độ tăng trưởng ngày càng tăng. Tôi thảo luận về cách cuộc tranh luận thay đổi kết luận của tôi ở đây.

- "Mô hình hóa quỹ đạo con người" nhấn mạnh rằng mô hình tạo ra những con số này "không đủ linh hoạt để đáp ứng đầy đủ các sự kiện lớn và đột ngột như cuộc cách mạng công nghiệp". Tác giả nói thêm: "Đặc biệt là bởi vì nó không hoàn toàn phù hợp với quá khứ, nên dự đoán cho tương lai của nó nên đọc hời hợt, chỉ đơn thuần là thêm tính hợp lý cho xu hướng tăng trong thế kỷ tới. Davidson (2021) ["AI tiên tiến có thể thúc đẩy tăng trưởng kinh tế bùng nổ không?"] chỉ ra một lối quan trọng khi các dự báo có thể tiếp tục sai lệch trong nhiều thập kỷ: trong khi động lực của mô hình bị chi phối bởi sự tăng tốc kinh tế không ngừng, con người vẫn là một yếu tố đầu vào quan trọng cho sản xuất, và, việc trở nên giàu có đã dẫn đến việc mọi người có ít con hơn. Trong những thập kỷ tới, điều đó có thể cản trở tốc độ tăng tốc dự đoán, đến mức chúng ta không thể hoặc không được thay thế robot cho người lao động."

- Những nhận xét này thường đề cập đến AGI hơn là AI biến đổi, nhưng các khái niệm đủ tương tự nhau để tôi sử dụng thay thế cho nhau ở đây.

- (Không có bằng chứng áp đảo, mà tôi không nghĩ rằng chúng ta nên giả định chung là sẽ luôn luôn có mặt khi "cần thiết").